【本地大模型工具包】iOS端侧模型部署避坑指南与深度体验

你是否也曾有过这样的困惑:当各大厂商都在鼓吹端侧AI的时候,我们的手机真的准备好了吗?Google近期发布的AIEdgeGallery,将2.5GB的Gemma模型硬生生塞进iPhone,这听起来像是一个极客的狂欢,但真的适合普通用户吗?最初接触到这个应用时,我怀着极大的怀疑。毕竟,在移动端跑大模型,往往意味着发热、卡顿和电量的飞速流逝。难道这又是一个厂商为了秀肌肉而推出的“面子工程”?带着这种审视的眼光,我开始了这场并不轻松的部署之旅。

安装过程出奇地顺利,但随之而来的是对性能的拷问。2.5GB的体积对于寸土寸金的手机存储来说,确实是一笔不小的开销。我不禁要问:为了一个本地离线对话功能,占用如此大的空间,真的划算吗?在实际体验中,虽然响应速度确实做到了“毫秒级”,但当你真的试图把它作为生产力工具时,那种不确定性便接踵而至。它能处理简单的对话,却在复杂逻辑面前显得有些捉襟见肘。

深度剖析:端侧运行的真实体验反思

我们需要清醒地认识到,本地模型并非万能药。虽然它解决了隐私安全和离线运行的需求,但其背后的算力损耗是用户必须承担的隐形成本。当开发者还在为模型调用工具的稳定性苦恼时,作为终端用户,我们是否愿意为这种尚不成熟的技术买单?这种技术虽然前卫,但目前更像是一个实验室里的试验品,而非成熟的商业化产品。

突破时刻:从工具调用看AI的边界

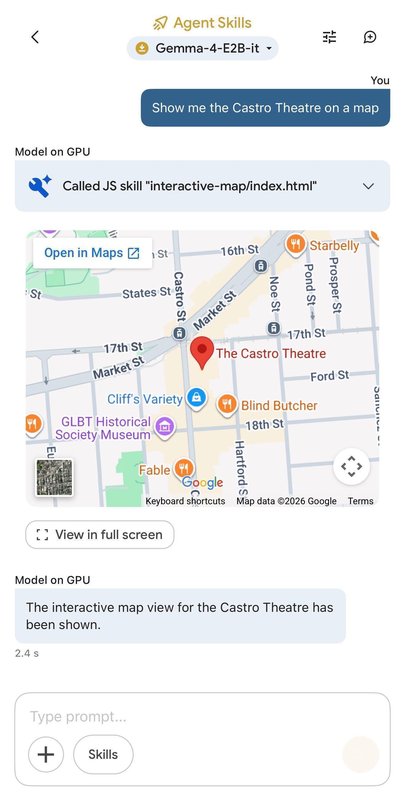

在测试“skills”模块时,我遇到了Willison提到的App冻结问题。这让我意识到,端侧AI的瓶颈不仅仅在于模型大小,更在于系统层面的调度能力。当模型试图调用外部工具时,一旦逻辑链条过长,iOS的神经网络引擎便会显得力不从心。这不仅仅是Google技术层面的难题,更是移动操作系统在面对大模型架构时,需要共同跨越的鸿沟。我们需要的是一个能够稳定运行的AI伴侣,而不是一个动不动就罢工的“实验性玩具”。

成长感悟:理性看待技术红利

经过这段时间的折腾,我逐渐明白,无论是AppleIntelligence还是Google的Gemma,它们都在试图定义移动端AI的未来。但作为用户,我们不应被这些营销术语所裹挟。本地模型固然代表了未来的方向,但当下的技术红利期,依然伴随着不可忽视的局限性。保持怀疑,不断测试,或许才是我们在AI时代应有的态度。